复旦大学计算机科学技术学院自然语言处理实验室(FudanNLP)的研究论文《A Multi-Format Transfer Learning Model for Event Argument Extraction via Variational Information Bottleneck》被COLING 2022以长文oral形式录用,并获得Outstanding Paper,论文第一作者为博士后周杰,指导老师为张奇教授和黄萱菁教授。国际计算语言学会议(International Conference On Computational Linguistics,COLING),是自然语言处理和计算语言学领域的顶级会议(CCF-B类),每两年举办一次。本次COLING会议共吸引了超过2000的投稿,最终共录用522篇长文、112篇短文,我院FudanNLP团队的论文获得了杰出论文奖。

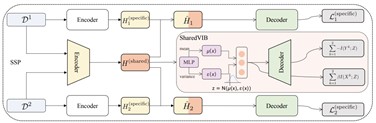

本文主要关注结构化抽取任务的统一迁移学习框架。近年来,基于深度学习的结构化抽取任务(如事件抽取)取得了巨大成功。然而目前大部分工作针对不同的数据集设定特定的模型结构。同时,由于结构化抽取任务的复杂性,标注空间较大,标注规范不统一,标注一个新的数据集往往是费时费力的。为此,本论文提出了一个基于变分信息瓶颈的多格式迁移模型来迁移不同格式的结构化数据集的知识。首先,作者提出共享-特定的提示模型用于从不同格式数据集学习格式特定和共享的表示。该模型可以使用统一的框架对不同格式的结构化数据集进行抽取。再者,变分信息瓶颈被用来约束模型学习格式共享的表示。最终,在三个标准数据集上取得了SOTA的结果。

图:结构化迁移学习框架

此外,该课题组在信息抽取、检索、对话等领域发表了大量高水平国际期刊和会议论文,其中包括中国计算机学会推荐的A/B类国际会议和期刊论文(ACL, SIGIR, IJCAI, AAAI, NIPS, ICML等)论文150余篇;参加多项国内外评测,如在自动问答国际评测TREC/QA中获得第3名,在文本蕴涵评测RITE和阅读理解评测SQUAD都位居前列。实验室发布了国内首家中文自然语言开源系统FudanNLP,被包括联合国教科文组织在内的国内外多家研发机构采用;发布了是一款轻量级的自然语言处理工具包FastNLP,可以用它来快速地完成一个NLP任务, 也可以用它在研究中快速构建更复杂的模型;发布了自然语言处理模型鲁棒性评测平台TextFlint,涵盖 12 项NLP 常见任务,囊括 80 余种数据变形方法,为模型鲁棒性评测及提升提供了一站式解决方案。