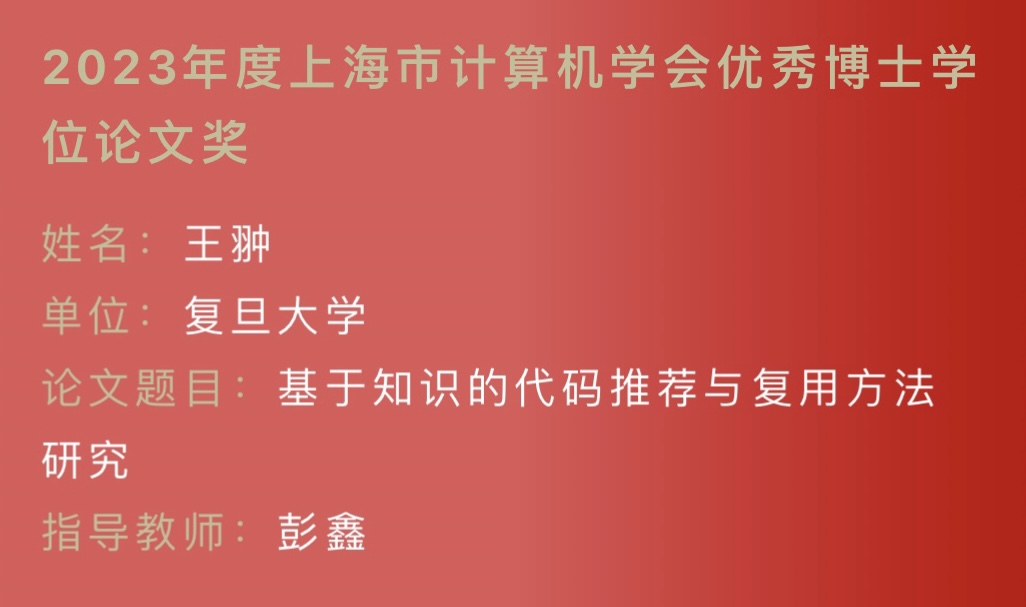

近期,上海市计算机学会公布了2023年度优秀博士、优秀硕士学位论文奖。学院1篇博士学位论文获评优秀博士学位论文奖,2篇硕士学位论文获评优秀硕士学位论文奖。

其中,王翀同学(导师:彭鑫)的论文《基于知识的代码推荐与复用方法研究》获优秀博士学位论文奖,程思婕同学(导师:肖仰华)的论文《预训练语言模型内部常识知识分析与应用》、祖心言同学(导师:李斌)的论文《针对难样本的汉字识别方法研究》获优秀硕士学位论文奖。

*以上截图来源于上海市计算机学会公众号

基于知识的代码推荐与复用方法研究

论文针对代码推荐与复用中的概念理解、缺陷检测、代码定制等问题,系统性地提出一种基于知识的研究框架,并在概念背景知识、代码规约知识、以及代码用法知识的表示、挖掘、使用方面展开了充分的研究,有效地提升了代码推荐的可解释性、资源泄露检测率、以及代码修改定制的效率。

王翀,复旦大学软件学院2023届软件工程专业博士毕业生,博士期间获得过国家奖学金、TCSE杰出论文奖等奖项,现于新加坡南洋理工大学担任博士后,继续从事研究工作。相关研究以第一作者发表于FSE、ASE、TSE、TOSEM等软件工程领域的顶级会议或期刊。

预训练语言模型内部常识知识分析与应用

主要针对预训练语言模型内部常识知识的分析和应用两个维度展开深入的研究。首先,针对预训练语言模型解决常识相关下游任务过程中,其背后工作机制仍有待探索这一问题,本文采用注意力机制和基于梯度的归因得分两种分析手段,探究预训练语言模型和常识知识之间的关系。其次,针对电子商务领域常识概念图谱中的上下位关系一般不存在于开放领域语料中,且无法直接利用手工模板显式地抽取,本文提出利用预训练语言模型解决常识概念图谱中上下位关系扩展任务,并在真实场景中,能以88%的精准度将上下位关系图谱中关系总数从39,263条扩展至94,698条。

程思婕,复旦大学软件学院2023届软件工程专业硕士毕业生。目前已发表ICLR、NeurIPS、ACL、CVPR等人工智能顶级会议论文10余篇,并主导OpenChat、EgoThink、FedGEMS等项目,其中OpenChat在GitHub上获得逾4.8k星标,FedGEMS已完成成果转化。曾获国家奖学金、上海优秀毕业生等荣誉。现于清华大学计算机系攻读博士学位。

针对难样本的汉字识别方法研究

汉字识别具有很多下游任务和广泛应用场景。目前汉字识别领域仍有潦草手写汉字样本、复杂背景汉字样本、缺损汉字样本等难题未被完全解决。论文根据三种困难样本的特点有针对性地设计了三种汉字识别方法:首先,论文提出了一个针对潦草手写汉字难样本中形似问题和一对多问题的汉字名片匹配识别方法;其次,论文针对复杂背景下的汉字难样本提出了一个结合文本分割与对比学习的汉字识别方法;最后,论文针对缺损汉字样本的识别设计了一个基于去噪扩散模型的缺损汉字修补方案。提出的方法有助于提升真实场景中的中文文本识别能力,在企业合作项目中得以应用,用于票据识别等任务。

祖心言,复旦大学计算机科学技术学院2023届计算机技术专业硕士毕业生,硕士期间主要进行文本识别、文本分割等应用研究,曾获计算机学院启明星辰奖学金等。研究生期间以第一作者发表CCF A类会议论文三篇:ACM MM-22、IJCAI-23、ACM MM-23。